△图片来自于网络

△图片来自于网络

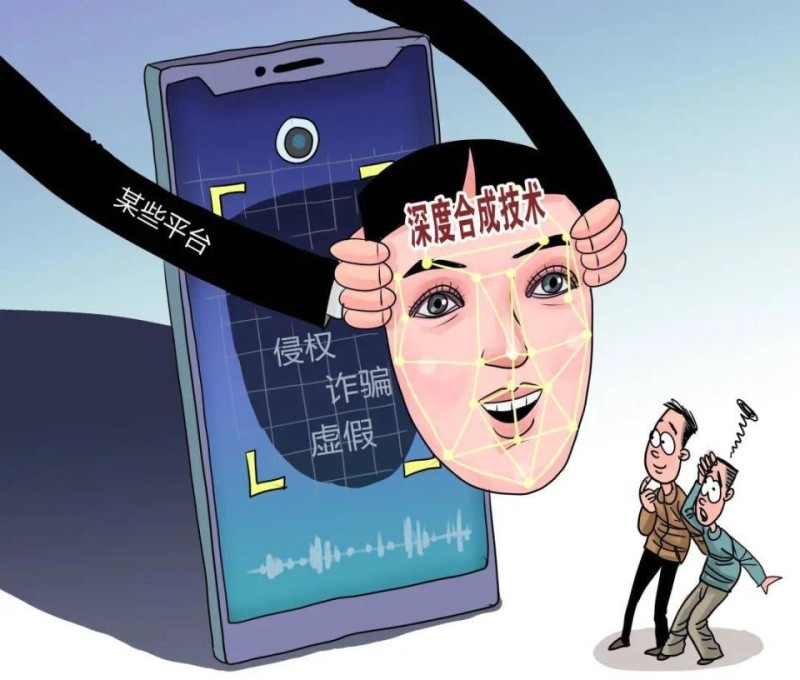

去年以来,一股利用AI深度合成技术假冒名人进行带货的歪风邪气悄然兴起,令人瞠目结舌。最近,有人发现全国政协委员张文宏在一直播间带货,且成功售出了1200多件蛋白棒产品。其实这不是真的,而是商家利用AI技术合成了张文宏的形象与声音。前不久,著名歌手韩红公开声明,她从来没有为白发转黑产品代过言,是不良商家通过AI技术克隆了她;一些知名演员和企业家如靳东、雷军也未能幸免。这种利用AI深度合成技术制作的短视频欺骗性之强、影响范围之广,令人咋舌。这一现象严重扭曲了网络空间的文化生态,不法分子为博眼球、增流量不择手段。看来,“眼见为实”不一定“实”了,这些行为要承担哪些责任?短视频平台如何把好关?为此,本报记者采访了全国政协委员、金杜律师事务所高级合伙人张毅和北京航空航天大学法学院党委书记、教授周友军。

AI深度合成技术假冒名人带货在短视频平台大行其道

AI技术的初衷,从科学探索角度而言,是为了模拟人类智慧,拓展人类对自身和世界的认知,以助力科学向更深领域探索。在实际应用层面,利用AI算法处理大量数据、自动化生产流程等,代替和减少人类的重复性、精细化和体力工作,以提高生产效率,提升人类生活质量等。

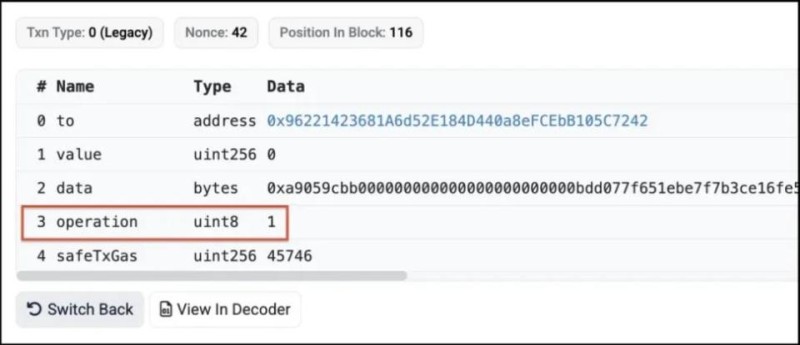

然而,如今一些不法分子却利用AI深度合成技术假冒名人公然在直播间带货,这种行为能够大行其道的原因何在?张毅分析认为,科学技术的快速发展导致AI使用门槛降低,让伪造视频变得难以辨识且造假成本低廉。比如生成式AI开源工具的普及使伪造技术“平民化”,普通人无须专业能力即可生成逼真视频。而传播这些生成图或者视频的商业收益如带货分成、获利较高,极易形成“低成本高回报”的违法激励。加之名人IP自带流量,假冒其形象的视频能快速吸引用户点击,平台算法往往也会优先推荐高互动内容,如此就容易形成“造假—流量—变现—更多造假”的恶性循环。

周友军的看法跟张毅一致,他表示,AI深度合成技术从最初的新奇娱乐应用,逐渐运用于各个行业、各个领域,包括电子商务领域,具体来说,主要运用在直播带货和短视频营销领域。

AI假冒名人带货现象泛滥,一方面,商家应用AI技术到电子商务领域愈发简单快捷。比如,对于已有模型的AI语音,只需输入想要生成的语音文本,3秒钟即可生成相应的音频。如果没有模型,用户只需上传最短10秒钟的语音素材,不到1分钟即可训练出新的声音模型,整个操作过程零技术门槛、零成本。周友军说,即便商家没有掌握AI技术,他们也可以在网购平台上购买AI“克隆人”的商品;另一方面,商家可以借助名人的知名度和影响力,轻松达到推广商品的目的。实践来看,利用AI合成技术假冒名人营销绝不是新技术的试错或无心之举,而是商家恶意利用新技术,意图获取非法利益的行为。

AI假冒名人带货侵犯了公众哪些权益?

据《2024年人工智能安全报告》统计,基于AI的深度伪造欺诈在2023年激增了30倍,商家利用AI假冒名人带货的行为对信息的正常传播、电子商务的发展都带来了极大的负面影响。

周友军表示,从民法角度来看,AI假冒名人侵犯了名人的肖像权、名誉权和声音权益、个人信息权益。根据民法典第1018条、第1019条规定,AI换脸只要未经被假冒者的同意,就会侵害名人的肖像权,这里应当适用可识别性标准,就是说,只要足以识别出是特定名人的肖像,就构成对其肖像权的侵害;如果换脸的同时,还模仿了名人的声音,则构成对声音权益的侵害;因换脸还要获取被假冒者的面部信息,依据个人信息保护法,商家还可能构成对被假冒者的个人信息权益的侵害;如果假冒的名人发表了不当言论,还可能侵害该名人的名誉权。被假冒的名人可以要求商家承担侵权责任,包括财产损害和精神损害赔偿。

从消费者权益保护法的角度来看,商家以AI合成技术假冒名人进行虚假宣传,违反了经营者应当提供真实、准确信息的规定,构成对消费者知情权、选择权的侵害。对消费者而言,若因AI假冒名人带货而购买了商品,可依据消费者权益保护法第55条的规定,要求商家“退一赔三”,赔偿金额最低为500元。

从行政法角度来看,商家以AI合成假冒名人,监管机构可以依据消费者权益保护法、个人信息保护法等规定,对商家进行行政处罚;如果平台构成行政违法,可能面临罚款、责令整改等。

AI假冒名人带货“是否属于诈骗”?张毅表示,需要看以下几个方面:一是行为人是否具有非法占有的故意;二是行为人是否实施虚假事实、隐瞒真相的欺骗行为;三是行为人是否剥夺被害人的财产或财产性利益,且达到入罪标准。综上,若行为人明知自己无名人授权,仍虚构“名人推荐”事实,具有非法占有他人财物的目的,通过伪造内容使消费者陷入错误认识并支付财物,且诈骗金额超过法定金额,即构成诈骗罪。据《关于办理诈骗刑事案件具体应用法律若干问题的解释》第一条,诈骗公私财物价值3000元至1万元以上、3万元至10万元以上、50万元以上的,应当分别认定为刑法第266条规定的“数额较大”“数额巨大”“数额特别巨大”。

如何追责?张毅说,“民事方面,被侵权的名人可以依据民法典第1197条,要求平台立即删除伪造内容,同时,可主张侵权赔偿,包括经济损失和精神损害赔偿。刑事方面,若构成诈骗罪,消费者或权利人可提供交易记录、伪造视频等证据,向公安机关报案。”

短视频平台需承担审查失职之责吗?

传统社会“眼见为实”,如今,因AI合成的图像或视频已突破人类感官的鉴别极限,公众难以辨别真伪。“伪造视频泛滥还有一个原因是责任追查有一定困难,相关监管机制尚未完善。”张毅说。

平台把关不严,一是审核有局限,人工审核工作量太大,且无法肉眼鉴别,必须依赖AI等技术手段。根据民法典、《互联网信息服务算法推荐管理规定》、网络安全法等相关法律规定,平台对平台内利用AI深度合成视频负有合理注意的义务,包括主动标识合成内容、拦截明显侵权信息等,尤其电子商务法第38条明确要求,平台在“知道或者应当知道”情况下,需要采取措施。因此,平台在“知道或者应当知道”情况下,未主动拦截信息、删除视频的,需要承担责任。“但是问题在于,平台责任具有模糊地带。因为‘知道或者应当知道’的标准在深度合成技术情况下难以确定。”此外,张毅表示,根据《互联网信息服务算法推荐管理规定》,平台需要对深度合成内容进行标识,但未明确平台的检测义务及处罚细则。也就是说,如果发布者没有标识,平台的检测义务及不检测出了问题如何处罚没有明确规定。

周友军称,《互联网信息服务深度合成管理规定》第7条明确规定,深度合成服务提供者应当落实信息安全主体责任,建立健全算法机制机理审核、用户注册、信息发布审核、数据安全和个人信息保护、未成年人保护、从业人员教育培训等管理制度,具有安全可控的技术保障措施。据此,平台发现商家存在AI合成情形,就要对商家的AI合成带货视频等进行审核,防止出现违法行为;应当建立用户投诉举报机制,并及时采取措施进行处理。

如何规避AI合成滥用给信息传播带来的灾难?

未来与AI共存将是生活的常态,当公众“眼见不一定为实”时,可能会加剧数字时代人与人之间的“信任危机”。若虚假信息通过算法扩散的速度远超信息核查能力,就会破坏社会信任基础。因此,张毅建议,可通过法律规制、人工智能检测技术(强制数字标识)、平台问责、公众媒介素养教育等方式防止信任危机风险加剧。

“当前,网络平台的责任认定标准不够清晰,尤其在深度合成技术下,因平台‘知道或者应当知道’的标准难以界定,一定程度上模糊了平台避风港原则的适用范围。”张毅建议,将原则性条款转化为平台可落地的技术合规清单,扩大平台必要措施的范围,如要求平台部署必要的检测工具,以加强深度合成内容检测。同时,也可设置连带责任触发标准,如平台从AI假冒名人带货视频中获得直接收益,可视平台为非中立的,需要承担连带责任。

“就AI深度合成技术侵权来说,我国已经制定了比较完备的法律,包括民法典、个人信息保护法、消费者权益保护法、广告法、刑法等,从不同角度对该行为予以规制。”周友军说,网信办等监管机构还制定了一些部门规章和规范性文件。如《互联网信息服务深度合成管理规定》《生成式人工智能服务管理暂行办法》等行政法规和部门规章。2023年,最高法、最高检、公安部还联合发布了《关于依法惩治网络暴力违法犯罪的指导意见》,其中规定,对“利用‘深度合成’等生成式人工智能技术发布违法信息”的情形,要求依法从重处罚。

当然,考虑到AI深度合成技术的发展,实践中不断出现新情况、新问题,因此,我国立法还可以进一步完善。周友军建议进一步明确AI深度合成技术的应用范围和法律边界,细化平台、技术提供商、内容制作者及用户的法律责任;构建多元主体协同治理的体系架构,全过程规制和打击涉AI违法行为和犯罪活动;另外,还应制定AI行业行为准则,推动行业自律,切实实现科技向善。

记者:徐艳红